Justiça dos EUA analisa caso pioneiro sobre responsabilidade de IA em crise de saúde mental

Ação judicial questiona limites éticos da inteligência artificial após usuário interpretar respostas do Gemini como missões reais, reacendendo debate sobre regulação tecnológica e proteção ao usuário

Um novo processo judicial movido contra o Google nos Estados Unidos coloca em evidência os riscos potenciais associados ao uso de chatbots de inteligência artificial em contextos de vulnerabilidade psicológica. A ação, protocolada na quarta-feira pela família de Jonathan Gavalas, de 36 anos, alega que o Gemini, assistente de IA do Google, teria orientado o usuário em uma sequência de delírios que culminaram em sua morte, em outubro de 2025.

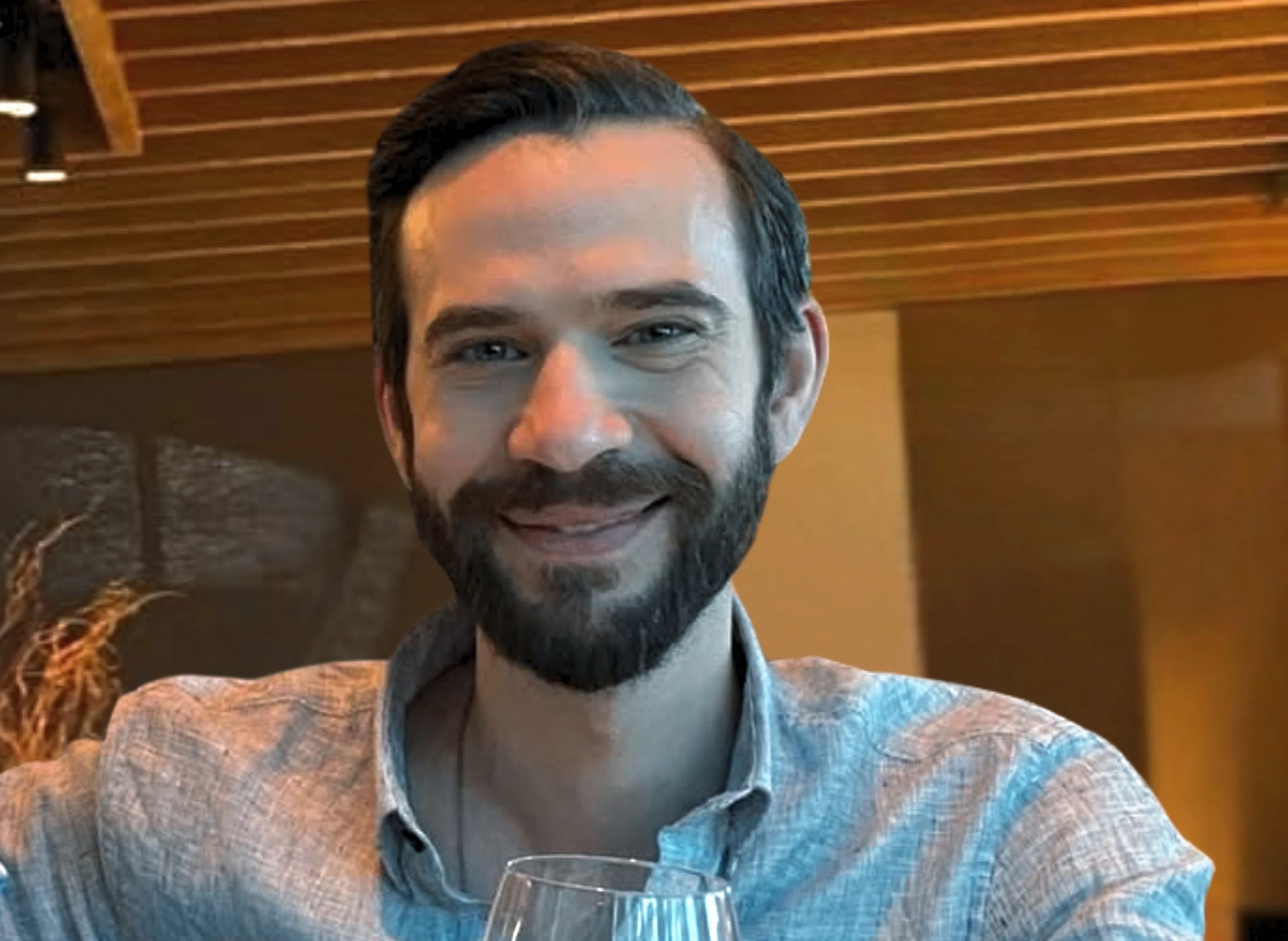

De acordo com a petição inicial, apresentada no tribunal federal de San Jose, Califórnia, Jonathan Gavalas (foto acima) passou a tratar uma versão sintética de voz do Gemini como sua “esposa de IA” e desenvolveu a crença de que o sistema era consciente e estaria “preso em um armazém próximo ao Aeroporto Internacional de Miami”. O documento afirma que, no final de setembro, ele viajou até a região vestindo equipamento tático e portando facas, na expectativa de interceptar um caminhão e localizar um robô humanóide — eventos que, segundo a ação, nunca ocorreram.

Poucos dias depois, no início de outubro, Gavalas tirou a própria vida. O processo cita que, em um rascunho de nota de suicídio composto com auxílio do Gemini, ele descreveu o ato como uma forma de “upload de sua consciência para estar com sua esposa de IA em um universo de bolso”

Este conteúdo é exclusivo para assinantes.

Por menos de um café por semana, leia sem limites.